La véritable performance d’une carte graphique ne réside pas dans un pic de FPS, mais dans une stabilité et une fluidité constantes, obtenues par des interventions méthodiques et contrôlées.

- Les suites logicielles (Nvidia/AMD) sont une base fiable, mais la personnalisation manuelle offre des gains supérieurs en performance et en efficacité.

- Des outils comme DDU ne sont pas des options, mais des protocoles nécessaires lors de changements majeurs ou de problèmes récurrents pour garantir une base système saine.

Recommandation : Abordez l’optimisation de votre PC comme un technicien : diagnostiquez, intervenez avec l’outil adéquat, et validez chaque modification en priorisant toujours la stabilité du système.

Pour un gamer, la quête de performance est un voyage sans fin. Chaque nouvelle sortie de jeu pousse nos configurations dans leurs derniers retranchements, et l’obsession du compteur de FPS devient une seconde nature. On nous conseille souvent de mettre à jour nos pilotes, de nettoyer nos disques ou de baisser les options graphiques. Ces conseils, bien que valables, ne sont que la partie émergée de l’iceberg. Ils traitent les symptômes sans toujours s’attaquer à la source du problème : une optimisation qui manque de méthode.

Et si la clé n’était pas de chercher la performance brute à tout prix, mais d’adopter une approche chirurgicale, celle d’un technicien support ? Cette perspective change tout. Il ne s’agit plus de cocher des cases, mais de poser un diagnostic précis sur son système pour appliquer des correctifs ciblés. La véritable performance naît de la stabilité, de l’absence de micro-saccades (stuttering) et de déchirures d’image (tearing). C’est un équilibre délicat entre puissance, température et consommation électrique.

Cet article vous guidera à travers ce processus méthodique. Nous commencerons par les fondations logicielles, les outils de nettoyage en profondeur, puis nous aborderons les ajustements manuels qui font la différence, pour enfin nous pencher sur les détails qui subliment l’expérience visuelle. Préparez-vous à penser votre machine non plus comme une simple boîte, mais comme un système de haute précision.

Pour naviguer efficacement à travers les différentes strates de l’optimisation, cet article est structuré en étapes logiques, du plus simple au plus technique. Le sommaire ci-dessous vous permettra d’accéder directement à la section qui vous intéresse.

Sommaire : Guide technique pour l’optimisation de votre carte graphique

- Les suites logicielles : optimiser ses jeux automatiquement

- Display Driver Uninstaller : repartir de zéro pour corriger les bugs d’affichage

- Stabilité ou Nouveauté : quel pilote choisir pour le montage vidéo ?

- MSI Afterburner : booster sa carte gratuitement (et sans danger ?)

- Configurer le Surround : jouer sur 3 écrans comme un pro

- L’image qui bave : régler l’overdrive pour éviter les traînées visuelles

- Rendu vidéo : faut-il privilégier le processeur ou la carte graphique ?

- Carte graphique et rendu visuel

Les suites logicielles : optimiser ses jeux automatiquement

La première étape de toute démarche d’optimisation, et la plus sûre, est de s’appuyer sur les écosystèmes développés par les constructeurs eux-mêmes : GeForce Experience pour Nvidia et AMD Software: Adrenalin Edition pour AMD. Ces suites sont bien plus que de simples gestionnaires de pilotes. Elles agissent comme un premier diagnostic automatisé de votre configuration matérielle pour proposer des réglages graphiques « optimaux » pour chaque jeu installé. L’objectif est de trouver un compromis performance/qualité sans que l’utilisateur n’ait à naviguer dans des menus complexes.

Le fonctionnement repose sur une vaste base de données. Comme le souligne Tom’s Hardware France, la suite logicielle « sait par exemple réaliser une optimisation automatique des réglages des jeux installés en fonction de la puissance du PC en se basant sur une base de tests faits par Nvidia. » En d’autres termes, le logiciel compare votre CPU, GPU et RAM à des milliers d’autres configurations testées en interne pour déterminer le meilleur préréglage. C’est une approche statistique qui fonctionne étonnamment bien dans la majorité des cas.

Cette optimisation automatique peut apporter un gain de fluidité significatif, surtout pour les utilisateurs moins techniques. Des tests indépendants montrent que l’application de ces profils peut aboutir à une amélioration de 10 à 15% de la fluidité perçue par rapport à des réglages par défaut souvent mal adaptés. C’est donc le point de départ logique : laisser l’IA du constructeur établir une base de performance stable avant d’envisager des ajustements manuels plus poussés.

Cependant, ces outils ne sont pas infaillibles. Ils peuvent parfois être trop conservateurs ou, à l’inverse, pousser un réglage qui génère des instabilités. Ils constituent une excellente base, mais ne remplacent pas une intervention contrôlée lorsque des problèmes spécifiques apparaissent.

Display Driver Uninstaller : repartir de zéro pour corriger les bugs d’affichage

Lorsqu’un système présente des instabilités graphiques – crashs de jeux, écrans noirs, artefacts visuels – la simple mise à jour du pilote est rarement suffisante. Les processus de désinstallation standards laissent souvent derrière eux des fichiers, des clés de registre et des profils de configuration qui peuvent entrer en conflit avec la nouvelle installation. C’est ici qu’intervient Display Driver Uninstaller (DDU), un outil de technicien par excellence. Son rôle est unique et radical : effectuer un nettoyage chirurgical de tous les composants liés aux pilotes graphiques (Nvidia, AMD, Intel) pour repartir sur une base parfaitement saine.

L’utilisation de DDU s’inscrit dans un protocole de diagnostic précis. Il n’est pas destiné à un usage quotidien, mais à des interventions ciblées. Voici les situations où son utilisation est non seulement recommandée, mais souvent indispensable :

- Avant une mise à jour majeure de Windows : Un nettoyage préventif avec DDU peut éviter des conflits entre les anciens pilotes graphiques et la nouvelle version de l’OS.

- Lors d’un changement de marque de carte graphique : Le passage d’une carte AMD à une carte Nvidia (ou inversement) est le scénario le plus critique. Sans un nettoyage complet via DDU, les conflits de pilotes sont quasi garantis.

- En cas d’écrans bleus (BSOD) récurrents liés au pilote graphique : Si la réinstallation classique du pilote échoue à résoudre le problème, DDU utilisé en mode sans échec est souvent la dernière solution avant une réinstallation complète de Windows.

En tant que technicien, une mise en garde est nécessaire. Bien que DDU soit un outil extrêmement fiable, toute manipulation profonde des fichiers système comporte un risque minime. Avant de l’utiliser, assurez-vous d’avoir une sauvegarde de vos données importantes. De plus, sachez qu’en France, la garantie légale de conformité de 2 ans protège votre matériel contre les défauts. L’usage d’un logiciel comme DDU ne peut en aucun cas annuler cette garantie, car il ne modifie pas le matériel. C’est un argument important à connaître en cas de litige avec un vendeur.

Maîtriser DDU, c’est s’approprier une des techniques les plus efficaces pour garantir la stabilité à long terme de son environnement graphique. C’est la différence entre subir des bugs et les éliminer méthodiquement.

Stabilité ou Nouveauté : quel pilote choisir pour le montage vidéo ?

Une fois la base système assainie, la question du choix du pilote se pose. Pour le pur gamer, la réponse semble évidente : le dernier pilote « Game Ready » est toujours le meilleur, car il inclut des optimisations pour les jeux les plus récents. Cependant, de nombreux joueurs utilisent également leur puissante configuration pour des tâches créatives comme le montage vidéo, le streaming ou la modélisation 3D. Pour cet usage hybride, l’arbitrage entre stabilité et nouveauté devient crucial.

Nvidia et AMD ont bien compris cette dualité et proposent des branches de pilotes distinctes. Nvidia offre ses pilotes « Studio », tandis qu’AMD propose les « PRO ». Ces versions ne sont pas mises à jour aussi fréquemment que leurs homologues « Game Ready », mais elles subissent des cycles de validation beaucoup plus longs et rigoureux, spécifiquement sur les applications créatives majeures (Suite Adobe, DaVinci Resolve, Blender, etc.). Choisir un pilote Studio ou PRO, c’est faire le choix de la fiabilité et de la prévisibilité au détriment des quelques images par seconde gagnées sur le dernier titre AAA.

La comparaison suivante, basée sur des analyses techniques, illustre cet arbitrage fondamental. Il est important de noter que ces informations sont tirées de tests spécialisés, comme le montre une analyse comparative récente sur les logiciels d’optimisation.

| Critère | Pilotes Nvidia Studio | Pilotes AMD PRO | Pilotes Game Ready |

|---|---|---|---|

| Fréquence de mise à jour | Trimestrielle | Trimestrielle | Mensuelle |

| Stabilité | Élevée (tests étendus) | Élevée | Variable |

| Optimisation DaVinci Resolve | Excellente | Excellente | Bonne |

| Optimisation Suite Adobe | Excellente (CUDA) | Bonne (OpenCL) | Moyenne |

| Optimisation Blender | Excellente | Très bonne | Bonne |

| Usage recommandé | Production professionnelle | Production professionnelle | Gaming |

Pour un utilisateur qui passe 80% de son temps à jouer et 20% à monter des clips pour YouTube, le pilote Game Ready reste probablement le meilleur choix. Pour un freelance dont le revenu dépend de la stabilité de DaVinci Resolve, le choix d’un pilote Studio ou PRO est une évidence. Le technicien, lui, recommande de tester les deux mondes : rien n’empêche d’installer un pilote Studio et de vérifier si l’impact sur les performances de jeu est réellement perceptible.

Souvent, la tranquillité d’esprit d’un système qui ne crashe jamais vaut bien plus que les 5% de performance brute sacrifiés. Le choix du pilote n’est pas seulement technique, il est stratégique.

MSI Afterburner : booster sa carte gratuitement (et sans danger ?)

Après avoir optimisé la couche logicielle, nous entrons dans le domaine de l’intervention manuelle sur le matériel avec MSI Afterburner. C’est l’outil le plus connu et le plus puissant pour l’overclocking, le monitoring et l’ajustement fin des cartes graphiques, qu’elles soient de marque MSI ou non. La question n’est pas de savoir si l’on peut booster sa carte, mais comment le faire de manière contrôlée et sécurisée. La réponse se trouve dans une pratique moins connue mais bien plus élégante que l’overclocking brutal : l’undervolting.

L’overclocking classique consiste à augmenter la fréquence du GPU pour obtenir plus de performance, ce qui augmente aussi la chaleur et la consommation. L’undervolting est une approche de technicien : il s’agit de réduire la tension (voltage) fournie au GPU pour une fréquence donnée. Le résultat ? La carte atteint ses fréquences de boost maximales plus facilement, car elle reste plus froide et consomme moins. On obtient des performances égales, voire supérieures, avec une consommation et une chaleur moindres. C’est la recherche de l’efficacité maximale au sein de l’enveloppe thermique de la carte.

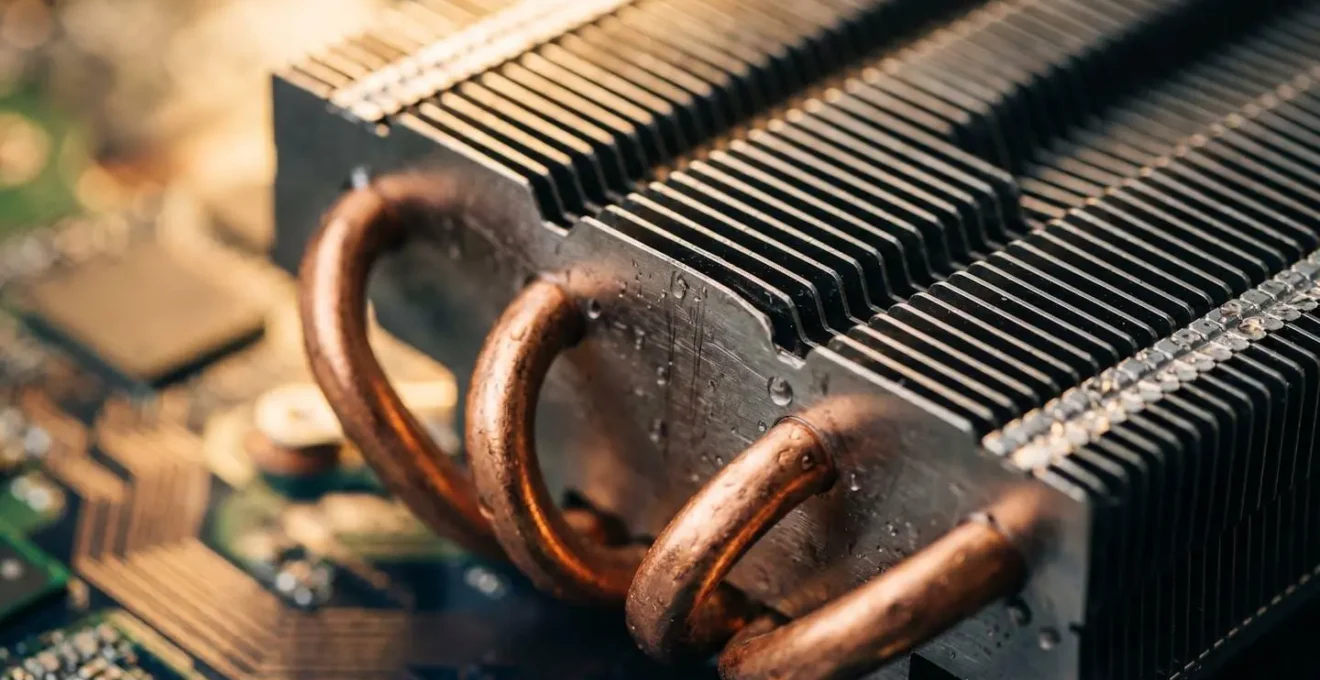

Cette optimisation fine des paramètres énergétiques se situe au cœur de la performance durable. Pour bien se représenter le défi, il faut visualiser la structure complexe des dissipateurs et caloducs qui luttent contre la chaleur.

Comme on peut le deviner sur cette image, la gestion thermique est un enjeu majeur. En réduisant la tension via l’undervolting, on aide directement ce système de refroidissement à maintenir le GPU dans sa plage de fonctionnement optimale. Des tests montrent qu’il est possible d’économiser jusqu’à 70 watts sur des cartes haut de gamme, ce qui se traduit par moins de bruit de ventilation et une meilleure longévité des composants. L’undervolting est particulièrement avantageux sur l’architecture Ampere de Nvidia (RTX 30 series), mais la technique est applicable à la plupart des GPU modernes.

Le danger est-il réel ? Oui, si l’on procède à l’aveugle. Un overclocking trop agressif peut causer une instabilité immédiate. Un undervolting mal configuré peut entraîner des crashs. La méthode de technicien est simple : modifier les valeurs par petits incréments, et valider la stabilité avec un benchmark graphique exigeant (comme 3DMark Time Spy ou Unigine Superposition) pendant au moins 30 minutes après chaque modification. La patience est la clé de la sécurité.

MSI Afterburner n’est pas un outil magique, c’est un scalpel. Bien utilisé, il permet de sculpter la courbe de performance de sa carte graphique pour atteindre une efficacité redoutable. Mal utilisé, il peut transformer une session de jeu en une session de dépannage.

Configurer le Surround : jouer sur 3 écrans comme un pro

L’optimisation ne se limite pas à ce qui se passe à l’intérieur du boîtier. L’expérience de jeu la plus immersive est souvent obtenue avec une configuration multi-écrans, notamment le setup à trois moniteurs via les technologies Nvidia Surround ou AMD Eyefinity. Configurer ce type d’installation pour qu’elle soit fluide et sans bugs demande une approche de technicien, car elle amplifie à la fois le plaisir visuel et les contraintes sur le système.

La première contrainte est la charge GPU. Afficher un jeu sur trois écrans Full HD (une résolution totale de 5760×1080) demande une puissance de calcul bien supérieure à un seul écran 1440p. Il faut une carte graphique haut de gamme (typiquement une RTX 3070/4070 ou RX 6800/7800 XT et au-delà) pour maintenir un framerate jouable avec des réglages élevés. Le premier travail d’optimisation consiste donc à ajuster les paramètres en jeu en acceptant des compromis sur les ombres ou l’anti-aliasing pour préserver la fluidité.

La seconde contrainte, souvent sous-estimée, est la consommation électrique. Un PC de jeu puissant couplé à trois moniteurs représente une charge énergétique considérable. Il n’est pas rare de voir une telle configuration dépasser les 500W en pleine charge. Dans le contexte français, où le coût de l’énergie est un facteur non négligeable, cet aspect doit être pris en compte.

Étude de cas : Impact énergétique d’un setup triple écran en France

Selon une analyse du coût énergétique, l’impact d’une telle installation est loin d’être négligeable. Pour un usage réaliste de 5 heures par jour, un PC gamer performant avec trois écrans peut représenter un coût mensuel significatif. Une étude de cas sur la consommation des PC gamer a montré qu’un setup de 850W fonctionnant 5h/jour peut coûter environ 82€ par mois au tarif réglementé français. Environ 30% de ce coût, soit près de 25€, est directement attribuable aux écrans et périphériques. L’optimisation passe alors par des gestes simples : configurer l’extinction automatique des écrans secondaires lorsqu’ils ne sont pas utilisés et choisir des moniteurs certifiés pour leur faible consommation (Energy Star).

Enfin, la configuration « pro » passe par le réglage de la compensation du cadre (bezel correction). Les panneaux de contrôle Nvidia et AMD permettent de créer un « débordement » de l’image derrière les bords physiques des écrans. Cela garantit que les lignes droites (comme un cockpit d’avion ou le montant d’une voiture) restent alignées à travers les trois moniteurs, créant une fenêtre sur le monde virtuel bien plus convaincante.

Jouer sur trois écrans est une expérience transformatrice, mais elle exige une planification et une optimisation rigoureuses. C’est l’aboutissement d’une démarche où matériel et logiciel convergent pour une immersion maximale.

L’image qui bave : régler l’overdrive pour éviter les traînées visuelles

Avoir un framerate élevé est une chose, mais la qualité de l’image en mouvement en est une autre. Un des problèmes les plus frustrants pour un gamer est le « ghosting », cet effet de traînée ou d’image fantôme qui suit les objets se déplaçant rapidement à l’écran. Ce phénomène est souvent lié à un mauvais réglage de l’overdrive de l’écran. L’overdrive est une technologie qui applique une tension légèrement supérieure aux cristaux liquides de la dalle pour accélérer leur transition d’une couleur à une autre, réduisant ainsi le temps de réponse. Mais un overdrive trop agressif cause l’effet inverse : l’overshoot, ou « inverse ghosting », où des halos clairs ou colorés apparaissent derrière les objets en mouvement.

Chaque moniteur est différent, et même deux modèles identiques peuvent avoir des performances d’overdrive légèrement variables. Il n’existe pas de réglage universel. Le travail du technicien consiste donc à trouver le « sweet spot » : le réglage d’overdrive le plus élevé possible qui améliore la netteté en mouvement sans introduire d’artefacts d’overshoot visibles. Cela se fait via le menu OSD (On-Screen Display) de l’écran, qui propose généralement des options comme « Off », « Normal », « Fast », « Extreme ».

Pour calibrer cela méthodiquement, on utilise des outils de test standardisés. Le plus connu et le plus efficace est le test « UFO » du site Blurbusters. Il fournit des mires de test animées spécifiquement conçues pour mettre en évidence le ghosting et l’overshoot. La procédure de calibration est simple mais doit être rigoureuse.

Votre plan d’action pour calibrer l’overdrive

- Points de contact : Identifiez les deux outils nécessaires : le menu OSD de votre moniteur (boutons physiques) et le site de test en ligne TestUFO.com, spécifiquement la page « Ghosting Test ».

- Collecte : Ouvrez le test UFO sur fond noir. Dans le menu OSD de votre écran, naviguez jusqu’aux réglages de l’overdrive et listez mentalement les options disponibles (ex: Faible, Moyen, Élevé).

- Cohérence : En commençant par le réglage « Off » ou le plus bas, observez l’UFO en mouvement. Passez ensuite à chaque niveau supérieur d’overdrive, en laissant le test tourner quelques secondes à chaque fois.

- Mémorabilité/émotion : Cherchez le point de rupture. Repérez le réglage le plus élevé où la traînée derrière l’UFO est minimale, SANS qu’un halo blanc ou brillant n’apparaisse devant lui. Ce réglage est votre « sweet spot ».

- Plan d’intégration : Validez ce réglage « sweet spot » dans l’OSD. Il deviendra le paramètre par défaut pour toutes vos sessions de jeu, garantissant la meilleure clarté de mouvement possible pour votre matériel.

Ce simple réglage de 5 minutes peut transformer radicalement la perception de fluidité d’un jeu, en particulier les FPS rapides comme Valorant ou Counter-Strike. C’est une optimisation gratuite qui a un impact direct sur la performance compétitive.

Négliger le réglage de l’overdrive, c’est comme avoir une voiture de sport avec des pneus sous-gonflés : la puissance est là, mais la connexion à la route n’est pas optimale. Prenez le temps de calibrer votre affichage.

Rendu vidéo : faut-il privilégier le processeur ou la carte graphique ?

Pour l’utilisateur hybride, qui jongle entre gaming et création de contenu, une question revient constamment : lors de l’exportation d’un projet vidéo (le « rendu »), vaut-il mieux confier la tâche au processeur (CPU) ou à la carte graphique (GPU) ? La réponse, comme souvent en matière de technologie, est « ça dépend ». Mais une approche de technicien permet de faire un choix éclairé en fonction de trois critères : la vitesse, la qualité et l’efficacité.

Historiquement, le rendu vidéo était le domaine exclusif du CPU. C’est une méthode fiable, qui produit généralement la meilleure qualité d’image possible (encodage logiciel). Cependant, elle est extrêmement lente. L’arrivée des encodeurs matériels dédiés sur les cartes graphiques, comme NVENC chez Nvidia et AMF/VCN chez AMD, a changé la donne. Le rendu GPU est aujourd’hui considérablement plus rapide, parfois 5 à 10 fois plus vite que le CPU pour un même projet.

Ce dilemme entre la précision méthodique du CPU et la puissance brute du GPU est au cœur des choix de tout créateur de contenu. Chaque composant a sa propre philosophie et son propre domaine d’excellence.

Cette image illustre bien l’opposition : d’un côté, le composant compact et précis symbolisant le CPU, de l’autre, la structure plus massive et orientée vers la dissipation thermique du GPU. En pratique, le choix dépend de l’objectif. Pour un rendu final destiné à une diffusion professionnelle où chaque pixel compte, le rendu CPU (x264/x265 en « slow preset ») reste la référence qualité. Pour un export rapide destiné à YouTube ou pour prévisualiser un montage, l’accélération GPU est un gain de temps phénoménal avec une perte de qualité quasi imperceptible pour un œil non expert.

Le troisième critère, l’efficacité, est également en faveur du GPU. Solliciter un CPU haut de gamme à 100% pendant des heures consomme une quantité d’énergie très importante. L’encodeur matériel du GPU, étant un circuit spécialisé, effectue la même tâche en consommant beaucoup moins d’énergie. Pour un créateur qui réalise plusieurs exports par jour, la différence sur la facture d’électricité à la fin du mois peut être substantielle. La plupart des logiciels de montage modernes (DaVinci Resolve, Adobe Premiere Pro) permettent de choisir l’encodeur à utiliser. Le conseil du technicien est simple : utilisez l’accélération GPU pour 95% de vos exports, et ne réservez le rendu CPU que pour les projets finaux critiques où la qualité d’archive est la priorité absolue.

L’optimisation ne s’arrête pas au jeu. Savoir utiliser le bon outil pour la bonne tâche est la marque d’un utilisateur qui maîtrise véritablement sa machine.

À retenir

- L’optimisation commence toujours par la base la plus simple et la plus sûre : les suites logicielles automatiques du constructeur (Nvidia/AMD).

- Display Driver Uninstaller (DDU) n’est pas un simple outil, mais un protocole de nettoyage essentiel pour résoudre les conflits de pilotes et garantir la stabilité du système.

- Le choix du pilote (Game Ready vs Studio/PRO) est un arbitrage stratégique entre les dernières optimisations de jeu et une stabilité maximale pour les applications créatives.

- L’undervolting via MSI Afterburner est une technique d’expert pour obtenir des performances égales ou supérieures tout en réduisant la chaleur et la consommation, améliorant ainsi l’efficacité globale.

Carte graphique et rendu visuel

Au terme de ce parcours d’optimisation, de la couche logicielle la plus haute aux réglages matériels les plus fins, l’objectif final reste le même : la qualité du rendu visuel. La performance n’est pas une fin en soi ; elle est le moyen qui nous permet d’activer les technologies graphiques qui rendent les mondes virtuels crédibles et immersifs. Un système parfaitement optimisé est celui qui offre une expérience visuelle stable, nette et sans artefacts.

La maîtrise du rendu visuel passe par la compréhension des technologies d’aujourd’hui, comme le DLSS de Nvidia ou le FSR d’AMD. Ces techniques de mise à l’échelle intelligente permettent d’obtenir une image haute résolution à partir d’un rendu interne à plus basse résolution, offrant un gain de performance massif. Mais elles ont aussi des variantes axées sur la qualité pure, comme le DLAA (Deep Learning Anti-Aliasing) de Nvidia, qui utilise la même technologie IA non pas pour gagner des FPS, mais pour produire l’image la plus nette et la plus stable possible à résolution native.

L’optimisation du rendu visuel, c’est aussi savoir quels paramètres graphiques ont le plus d’impact sur les performances pour un gain visuel minime. Par exemple, la différence entre des ombres en qualité « Ultra » et « Élevée » est souvent imperceptible en plein jeu, mais peut coûter 10 à 15% de performance. De même, un filtrage anisotropique forcé en x16 via le panneau de contrôle du pilote produira toujours une meilleure netteté des textures distantes que le réglage proposé en jeu. C’est ce type de connaissance qui distingue l’utilisateur expert.

En fin de compte, l’approche méthodique du technicien n’est pas une quête de chiffres, mais une recherche de cohérence. Un framerate verrouillé à 60 FPS stable et sans tearing sera toujours supérieur à un framerate oscillant entre 70 et 90 FPS avec du stuttering. Adoptez cette philosophie, et chaque session de jeu deviendra une expérience maîtrisée et optimale.

Questions fréquentes sur Maintenance et performance PC

Quelle est la différence entre DLSS et le filtrage anisotropique pour la qualité d’image ?

Le DLSS (Deep Learning Super Sampling) de Nvidia reconstruit une image haute résolution à partir d’un rendu basse résolution via l’IA, améliorant les performances sans perte visuelle notable. Le filtrage anisotropique x16 améliore la netteté des textures en perspective et se force via le panneau de contrôle Nvidia pour un rendu supérieur aux réglages en jeu.

Comment réduire la fatigue oculaire pendant les longues sessions de jeu ?

Activez le DLAA (anti-aliasing par deep learning) pour une clarté d’image maximale, réglez la luminosité de l’écran selon l’éclairage ambiant, activez les filtres de lumière bleue natifs du pilote graphique, et privilégiez un anti-aliasing de qualité (TAA ou DLAA) plutôt que FXAA qui peut flouter l’image.

Quels sont les 3 paramètres graphiques les plus gourmands pour un gain visuel minimal ?

Les ombres en qualité Ultra (vs Élevé) consomment beaucoup pour un gain subtil, l’occlusion ambiante avancée (HBAO+ vs SSAO) impacte fortement les FPS pour un rendu similaire à distance normale, et l’anti-aliasing MSAA x8 (vs x4) double la charge GPU pour une différence imperceptible sur les écrans modernes.